高速數據處理 定義、最新進展與商務咨詢價值

在當今這個信息爆炸的時代,數據已成為驅動商業決策、科學研究和日常生活的核心燃料。而如何高效、精準地處理海量、快速變化的數據流,便催生了對“高速數據處理”技術的迫切需求。本文將深入探討高速數據處理的內涵,梳理其最新技術動態,并闡明其在商務信息咨詢領域的關鍵價值。

一、什么是高速數據處理?

高速數據處理,是指在數據生成后極短的時間窗口內(通常是毫秒、微秒甚至納秒級),完成對數據的捕獲、傳輸、清洗、分析、存儲和響應的全過程。它超越了傳統批量處理的模式,強調“實時”或“近實時”的能力。其核心挑戰在于應對數據的“3V”特性在高速場景下的極致化:

- 海量(Volume):數據源持續不斷地產生巨量數據。

- 高速(Velocity):數據生成和傳輸的速度極快,如金融市場的交易數據、物聯網傳感器數據、在線用戶行為日志等。

- 多樣(Variety):數據格式復雜,可能包括結構化、半結構化和非結構化數據。

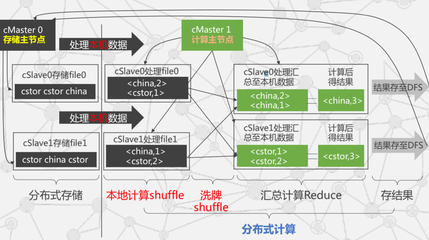

實現高速數據處理依賴于一系列關鍵技術棧,包括分布式計算框架(如Apache Flink、Apache Storm、Spark Streaming)、高性能消息隊列(如Apache Kafka、Pulsar)、流數據庫、內存計算以及優化的網絡和存儲基礎設施。

二、高速數據處理的最新報道與技術前沿

該領域正以前所未有的速度演進,近期的主要趨勢和報道焦點包括:

- 流批一體架構成為主流:以Apache Flink為代表的框架,正推動流處理(實時)和批處理(歷史)在編程模型和底層執行引擎上的統一。企業無需維護兩套系統,即可同時滿足實時分析與歷史數據挖掘的需求,極大簡化了架構復雜度和運維成本。

- 實時人工智能與機器學習:將機器學習模型集成到數據流中,實現實時預測、異常檢測和智能決策。例如,實時反欺詐系統可以在交易發生的瞬間分析數百個特征并做出攔截判斷;工業物聯網平臺能實時預測設備故障。

- 云原生與Serverless化:主流云服務商(AWS Kinesis, Google Cloud Dataflow, Azure Stream Analytics)提供了全托管的高速數據處理服務。企業可以更專注于業務邏輯,而無需管理底層集群,實現了彈性伸縮和按需付費。

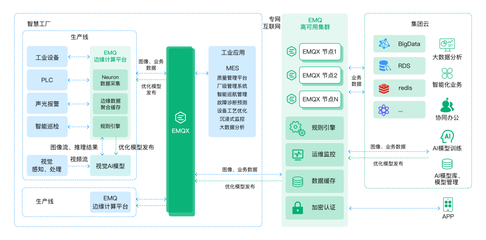

- 邊緣計算的深度融合:為應對網絡延遲和數據隱私挑戰,高速數據處理能力正下沉至網絡邊緣。在靠近數據源頭的邊緣設備或網關進行初步過濾、聚合和分析,只將關鍵結果或匯總信息傳回云端,大幅提升了響應速度和系統可靠性。

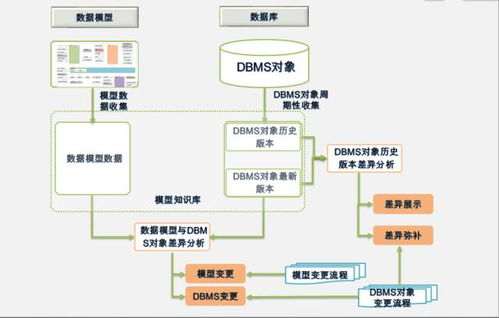

- 實時數據湖與數據倉庫的演進:諸如Apache Iceberg、Hudi和Delta Lake等表格格式,使得在數據湖上也能進行高效的流式更新和實時查詢,模糊了數據湖與實時數據倉庫的界限,支撐更靈活的實時分析場景。

三、高速數據處理在商務信息咨詢中的核心價值

對于商務信息咨詢行業而言,高速數據處理已從“加分項”演變為“必需品”,它重塑了咨詢服務的洞察力、速度和精準度:

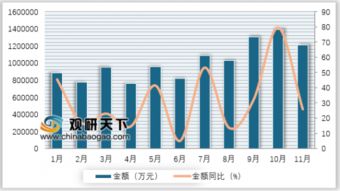

- 驅動實時商業決策:咨詢公司可以幫助客戶構建實時儀表盤和預警系統,監控關鍵業務指標(如銷售額、網站流量、供應鏈狀態、社交媒體輿情)。決策者能夠基于最新的市場動態而非上周的報告做出調整,把握轉瞬即逝的商機或規避風險。

- 深化客戶洞察與個性化體驗:通過實時分析用戶行為流數據,咨詢顧問可以協助企業繪制動態的客戶旅程圖,即時識別客戶意圖、偏好與痛點。這為實施個性化的營銷推薦、動態定價和客戶服務干預提供了可能,極大提升客戶滿意度和轉化率。

- 優化運營與風險管理:在金融、零售、物流等行業,高速數據處理能力是風險控制和運營效率的生命線。咨詢項目可以圍繞構建實時反欺詐、信用風險監控、物流路線動態優化、生產線質量實時檢測等系統展開,直接為企業降本增效、保障安全。

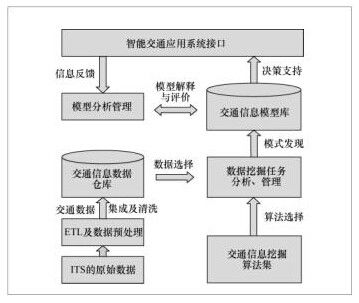

- 孵化數據驅動的創新產品與服務:咨詢公司可以借助高速數據處理技術,協助客戶探索新的商業模式。例如,基于實時位置和交通數據的智能出行服務,基于實時能源消耗數據的節能解決方案,或基于實時供應鏈數據的柔性制造平臺。

- 提升咨詢分析本身的速度與深度:咨詢團隊在項目調研階段,可以利用高速數據處理工具快速采集、清洗和分析多源異構的公開及私有數據,縮短分析周期,讓結論和建議建立在更及時、更全面的數據基礎之上。

高速數據處理技術正不斷打破數據價值釋放的速度壁壘。它不僅是一套復雜的技術集合,更是企業構建核心競爭優勢的戰略能力。對于商務信息咨詢行業,深刻理解并善用這項能力,意味著能為客戶提供更具前瞻性、響應力和可操作性的解決方案,在數據驅動的商業新時代,共同駕馭信息的洪流,將實時洞察轉化為切實的商業成功。

如若轉載,請注明出處:http://www.haogf.cn/product/63.html

更新時間:2026-04-14 02:06:34